La tecnología de IA de la Universidad de Washington permite a los usuarios de auriculares elegir sonidos específicos para escuchar

Un equipo dirigido por investigadores de informática de la Universidad de Washington (UofW) ha creado un software de IA para auriculares que permite a los usuarios seleccionar sonidos específicos para escuchar. A diferencia de los auriculares con cancelación de ruido que simplemente filtran todo excepto las voces, la nueva red neuronal permite a los usuarios seleccionar sonidos específicos como el gorjeo de un pájaro.

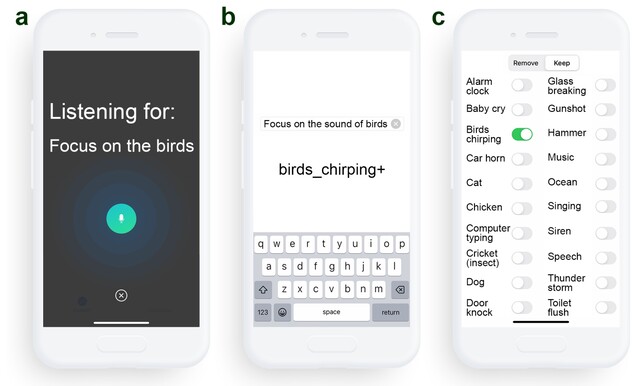

Los auriculares anteriores, como los capullos INZONE de Sony(disponibles en Amazon), utilizan DSEE Extreme, Speak-to-Chaty AI DNNtecnología de IA para mejorar la calidad de la música y el habla, al tiempo que dejan pasar automáticamente las voces a través de la cancelación de ruido cuando comienzan las conversaciones. El trabajo de la UofW avanza sobre esto permitiendo a los oyentes elegir entre 20 tipos diferentes de sonidos para escuchar, como el piar de los pájaros, el océano, el golpe de la puerta y la cisterna del váter, mientras filtra todo lo demás. Denominada audición semántica, esto permite a los usuarios disfrutar del piar de los pájaros en un parque sin oír a la gente hablar o los coches pasar.

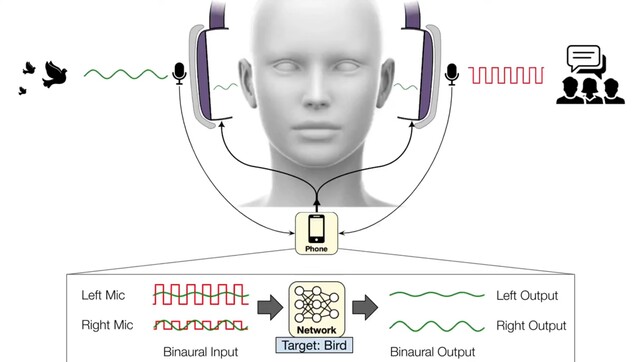

En la actualidad, la aplicación de la UofW utiliza micrófonos binaurales para captar la posición en tiempo real de los sonidos externos antes de enviar los sonidos filtrados a los auriculares. Dado que este software se ejecuta en teléfonos inteligentes, su aplicación puede aprovechar CPU más potentes que las que se encuentran en los auriculares, sin embargo, es sólo cuestión de tiempo que los auriculares con cancelación de ruido vengan con la audición semántica incorporada.

Top 10 Análisis

» Top 10 Portátiles Multimedia

» Top 10 Portátiles de Juego

» Top 10 Portátiles de Juego ligeros

» Top 10 Portátiles Asequibles de Oficina/Empresa

» Top 10 Portátiles de Juego Ligeros

» Top 10 Portátiles de Oficina/Empresa Premium

» Top 10 Estaciones de Trabajo

» Top 10 Subportátiles

» Top 10 Ultrabooks

» Top 10 Convertibles

» Top 10 Tablets

» Top 10 Tablets Windows

» Top 10 Tablets de menos de 250 Euros

» Top 10 Phablets (>5.5")

» Top 10 Smartphones

» Top 10 Smartphones (≤5")

» Top 10 Smartphones de menos de 300 Euros

» Top 10 Smartphones de menos de 120 Euros

» Top 10 Portátiles de menos de 1000 Euros

» Top 10 Portátiles de menos de 500 Euros

» Top 10 Portátiles de menos de 300 Euros

» Los Mejores Displays de Portátiles Analizados por Notebookcheck

Fuente(s)

Universidad de Washington, ACM, y Escuela Paul G. Allen (YouTube)

9 de noviembre de 2023

La nueva tecnología de auriculares con supresión de ruido por IA permite a los usuarios elegir qué sonidos escuchan

Stefan Milne

Noticias de la UW

Cualquiera que haya utilizado auriculares con supresión de ruido sabe que oír el ruido adecuado en el momento adecuado puede ser vital. Alguien puede querer borrar las bocinas de los coches cuando trabaja en interiores, pero no cuando camina por calles concurridas. Sin embargo, la gente no puede elegir qué sonidos cancelan sus auriculares.

Ahora, un equipo dirigido por investigadores de la Universidad de Washington ha desarrollado algoritmos de aprendizaje profundo que permiten a los usuarios elegir qué sonidos se filtran a través de sus auriculares en tiempo real. El equipo llama al sistema "audición semántica" Los auriculares transmiten el audio capturado a un teléfono inteligente conectado, que cancela todos los sonidos ambientales. Mediante comandos de voz o una aplicación del smartphone, los usuarios de los auriculares pueden seleccionar qué sonidos quieren incluir de entre 20 clases, como sirenas, llantos de bebé, habla, aspiradoras y gorjeos de pájaros. Sólo los sonidos seleccionados se reproducirán a través de los auriculares.

El equipo presentó sus hallazgos el 1 de noviembre en el UIST '23 de San Francisco. En el futuro, los investigadores planean lanzar una versión comercial del sistema.

"Entender cómo suena un pájaro y extraerlo de todos los demás sonidos de un entorno requiere una inteligencia en tiempo real que los actuales auriculares antirruido no han conseguido", afirma el autor principal Shyam Gollakota, profesor de la UW en la Escuela Paul G. Allen de Informática e Ingeniería. "El reto es que los sonidos que oyen los usuarios de auriculares tienen que sincronizarse con sus sentidos visuales. No puedes estar oyendo la voz de alguien dos segundos después de que te hable. Esto significa que los algoritmos neuronales deben procesar los sonidos en menos de una centésima de segundo"

Debido a esta escasez de tiempo, el sistema de audición semántica debe procesar los sonidos en un dispositivo como un smartphone conectado, en lugar de en servidores en la nube más robustos. Además, como los sonidos procedentes de distintas direcciones llegan a los oídos de las personas en momentos diferentes, el sistema debe preservar estos retardos y otras señales espaciales para que las personas puedan seguir percibiendo de forma significativa los sonidos de su entorno.

Probado en entornos como oficinas, calles y parques, el sistema fue capaz de extraer sirenas, gorjeos de pájaros, alarmas y otros sonidos de objetivos, al tiempo que eliminaba el resto de ruidos del mundo real. Cuando 22 participantes calificaron la salida de audio del sistema para el sonido objetivo, dijeron que, de media, la calidad mejoraba en comparación con la grabación original.En algunos casos, el sistema tuvo problemas para distinguir entre sonidos que comparten muchas propiedades, como la música vocal y el habla humana. Los investigadores señalan que el entrenamiento de los modelos con más datos del mundo real podría mejorar estos resultados.

Otros coautores del artículo son Bandhav Veluri y Malek Itani, ambos estudiantes de doctorado de la UW en la Escuela Allen; Justin Chan, que completó esta investigación como estudiante de doctorado en la Escuela Allen y ahora está en la Universidad Carnegie Mellon; y Takuya Yoshioka, director de investigación de AssemblyAI.

Para más información, póngase en contacto con [email protected].