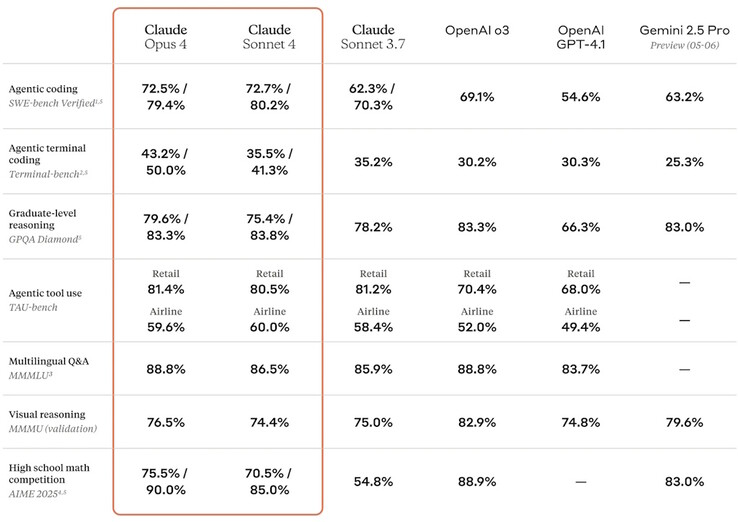

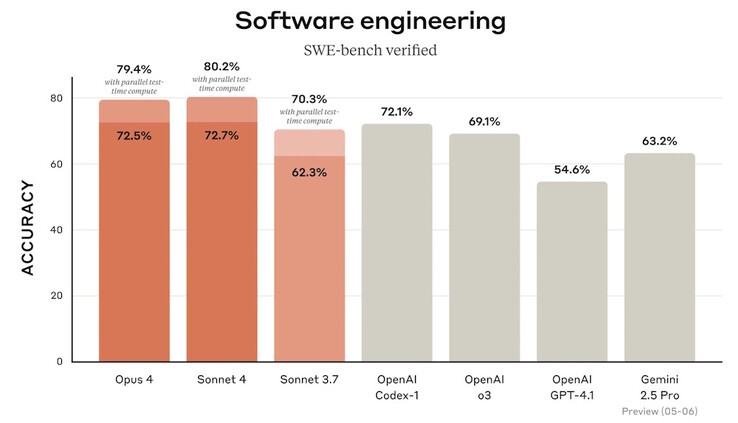

Anthropic ha lanzado el Claude Opus 4 y Claude Sonnet 4 modelos de inteligencia artificial con mayor precisión, capacidad y rendimiento.

Opus es el modelo más inteligente de la empresa, capaz de trabajar en problemas complejos y difíciles durante horas sin parar. Algunos de los primeros usuarios lo encontraron trabajando de forma independiente en tareas de programación durante siete horas, y la IA puede recordar mejor las entradas y los resultados para mejorar las respuestas. Sonnet es su modelo general para respuestas rápidas a indicaciones generales. Ambos han mejorado la precisión de codificación para ayudar a los programadores a crear las últimas aplicaciones.

Ambos modelos pueden actuar como analistas de datos escribiendo código Python para analizar y visualizar conjuntos de datos. Varias funciones nuevas de la API permiten a las empresas crear apps personalizadas que integran Claude para mejorar el análisis y la funcionalidad de los datos empresariales. Claude Code permite a la IA trabajar dentro de IDEs populares como VS Code y JetBrains para ayudar a los programadores a codificar mejor.

Anthropic ha activado sus normas de despliegue y seguridad del nivel de seguridad 3 (ASL-3) de la IA https://www.anthropic.com/activating-asl3-report como medida de precaución para Claude Opus 4 porque la empresa aún no ha descartado la posibilidad de que la IA sea capaz de realizar actos peligrosos, como ser jailbreakeada y utilizada para crear armas químicas, biológicas, radiológicas y nucleares (QBRN).

Los lectores que quieran experimentar las ventajas de la IA antrópica en el trabajo pueden utilizar Plaude Note o Plaude NotePin para resumir y transcribir automáticamente clases y reuniones. Los que se queden trabajando desde casa pueden chatear con Claude después de descargándose la aplicación Anthropic para portátiles y smartphones.

Fuente(s)

Top 10 Análisis

» Top 10 Portátiles Multimedia

» Top 10 Portátiles de Juego

» Top 10 Portátiles de Juego ligeros

» Top 10 Portátiles Asequibles de Oficina/Empresa

» Top 10 Portátiles de Juego Ligeros

» Top 10 Portátiles de Oficina/Empresa Premium

» Top 10 Estaciones de Trabajo

» Top 10 Subportátiles

» Top 10 Ultrabooks

» Top 10 Convertibles

» Top 10 Tablets

» Top 10 Tablets Windows

» Top 10 Tablets de menos de 250 Euros

» Top 10 Phablets (>5.5")

» Top 10 Smartphones

» Top 10 Smartphones (≤5")

» Top 10 Smartphones de menos de 300 Euros

» Top 10 Smartphones de menos de 120 Euros

» Top 10 Portátiles de menos de 1000 Euros

» Top 10 Portátiles de menos de 500 Euros

» Top 10 Portátiles de menos de 300 Euros

» Los Mejores Displays de Portátiles Analizados por Notebookcheck