El Acer Swift Go 16 AI, con 16 GB de RAM y un AMD Ryzen 7 350, se ha sometido últimamente a nuestras pruebas. El añadido "AI" en su nombre sugiere que este portátil está preparado para aplicaciones de IA. Nuestra revisiónsugiere, sin embargo, que la memoria podría quedarse algo corta para este uso. No obstante, los modelos de lenguaje, los generadores de imágenes y las herramientas de vídeo son cada vez más potentes y siguen necesitando menos RAM. Sobre el papel, algunos modelos de IA interesantes podrían funcionar con la memoria del portátil. Los hemos puesto a prueba.

La última versión de Windows 11 ya incluye varias herramientas de IA, algunas de las cuales se ejecutan localmente y otras en servidores de Microsoft. Por desgracia, no siempre está claro de dónde obtienen Copilot y otras su potencia de cálculo. La app Copilot requiere sistemáticamente una conexión activa a Internet. Algunas funciones de la aplicación Fotos funcionan localmente sin conexión a Internet, mientras que otras requieren una cuenta de Microsoft y no funcionan sin conexión. Las mejoras en la calidad de imagen y audio de las grabaciones de la cámara web se gestionan localmente a través de la NPU (Unidad de procesamiento neuronal). También se ha reintroducido la función Recuperar de Microsoft, que suscitó cierta controversia. Sin embargo, sigue desactivada por defecto y sólo se puede utilizar cuando el cifrado del dispositivo y la protección por contraseña están activados. Muchas otras funciones de IA de Windows no son especialmente llamativas o sólo funcionan con Microsoft Office.

Para utilizar localmente modelos lingüísticos alternativos y herramientas de generación de imágenes, necesita un software específico. Sin embargo, el proceso de conseguir que estos programas funcionen en su ordenador doméstico ya no es tan engorroso como lo era hace tan sólo un año. Ahora, existe un software sencillo para ambos, que se instala rápidamente y abre muchas posibilidades al usuario. Amuse ofrece software para la generación y edición de imágenes AI, adaptado específicamente al hardware AMD del Acer Swift Go 16 AI. LM Studio proporciona una forma cómoda de utilizar SLM (pequeños modelos de lenguaje), básicamente IA para la generación de texto. FastFlowLM no es tan cómodo de usar, pero se ejecuta con mayor eficiencia energética en la NPU. Instalamos los tres programas en nuestro dispositivo de prueba. Sin embargo, el Acer Swift Go 16 AI que utilizamos lamentablemente no está equipado de forma óptima con sólo 16 GB de memoria. Windows y los programas preinstalados de Acer consumen rápidamente entre seis y nueve gigabytes de la limitada memoria. Esto deja aproximadamente 10 GB de memoria disponible para la IA. Amuse determina que se pueden utilizar unos 8 GB de memoria. LM Studio calcula 15 GB, pero se bloquea cada vez que intentamos cargar un modelo lingüístico suficientemente grande.

AMUSE - Edición y generación de imágenes AI

Estábamos ejecutando Amuse en su última versión en el momento de las pruebas (3.1). El software es gratuito y se instala cómodamente. Es compatible con la NPU del procesador AMD, lo que debería acelerar notablemente el trabajo con IA, incluso sin una GPU dedicada. Además de la generación de texto a imagen, también ofrece funcionalidades de imagen a vídeo e imagen a imagen.

Para generar imágenes realmente, primero debe instalar Amuse y luego cargar los modelos adecuados. Esto se consigue con el programa, lo que es relativamente sencillo pero lleva mucho tiempo porque cada modelo contiene varios gigabytes de datos. De los tres preajustes que Amuse ofrece en modo principiante, la opción "Equilibrado" no nos funciona. "Rápido" y "Calidad", sin embargo, sí funcionan, aunque sólo el modo rápido funciona realmente sin problemas. El modo "Rápido" se basa en el pequeño Dreamshaper LCM Turbo. Cabe bien en la limitada memoria del portátil y funciona muy rápidamente. Las imágenes se generan en segundos. En el modo experto, StableDiffusion XL Turbo y StableDiffusion 3 también funcionan. Este último puede incluso descargarse en la NPU. Pero ambos modelos utilizan al máximo la memoria del portátil y no se ejecutan realmente con rapidez. La utilización de la memoria es particularmente problemática una vez que Amuse se está ejecutando, nada más en el portátil funciona sin problemas. En casos graves, Amuse incluso se bloquea si una ventana del navegador en segundo plano demanda demasiada memoria. Sólo el uso del pequeño Dreamshaper LCM es agradable. Con todo, produce resultados relativamente buenos. Sin embargo, sus raíces son claramente visibles en Stable Diffusion 1.5. Si no presta mucha atención a las indicaciones, verá muchos bordes difusos y proporciones extrañas. Pero Dreamshaper LCM también es increíblemente rápido. En un abrir y cerrar de ojos, este modelo puede crear imágenes. Aquí se prioriza la cantidad sobre la calidad. Una vez que una imagen ya es razonablemente pasable. La calidad puede mejorarse aún más en Amuse con la edición imagen a imagen.

Top 10 Análisis

» Top 10 Portátiles Multimedia

» Top 10 Portátiles de Juego

» Top 10 Portátiles de Juego ligeros

» Top 10 Portátiles Asequibles de Oficina/Empresa

» Top 10 Portátiles de Juego Ligeros

» Top 10 Portátiles de Oficina/Empresa Premium

» Top 10 Estaciones de Trabajo

» Top 10 Subportátiles

» Top 10 Ultrabooks

» Top 10 Convertibles

» Top 10 Tablets

» Top 10 Tablets Windows

» Top 10 Tablets de menos de 250 Euros

» Top 10 Phablets (>5.5")

» Top 10 Smartphones

» Top 10 Smartphones (≤5")

» Top 10 Smartphones de menos de 300 Euros

» Top 10 Smartphones de menos de 120 Euros

» Top 10 Portátiles de menos de 1000 Euros

» Top 10 Portátiles de menos de 500 Euros

» Top 10 Portátiles de menos de 300 Euros

» Los Mejores Displays de Portátiles Analizados por Notebookcheck

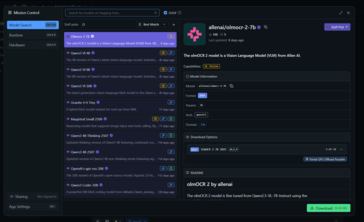

LM Studio - Chatbots, modelos de razonamiento y más

LM Studio es un sistema de gestión y ejecución de modelos lingüísticos. En su portátil, los derivados de ChatGPT, Llama, Qwen3 y otros pueden ejecutarse localmente. Al igual que con Amuse, el factor limitante para la IA del Acer Swift Go 16 parece ser la escasa memoria, más que la potencia de procesamiento. El nuevo gpt-oss 20B de OpenAI se bloquea al cargarse por falta de memoria. Basándonos en la experiencia, podemos confirmar que el modelo funciona sin problemas en portátiles con AMD Ryzen 9 370 y 32 GB de memoria.

Qwen3 Vi 8B, Qwen3 4B Thinking y Granite 4 H Tiny de IBM (Q4_K_M y Q8_0) funcionaron sorprendentemente bien en el portátil Acer. El modelo de lenguaje más pequeño de IBM es notablemente rápido y brilla con respuestas suficientes. Qwen3 Vi 8B impresiona con un tono muy natural en su habla y demuestra cualidades particulares en el procesamiento de imágenes. Para las personas con visión reducida, una IA de este tipo podría suponer una gran ayuda en un ordenador portátil. El modelo de razonamiento Qwen3 4B Thinking es el más lento en nuestras pruebas cuando se trata de respuestas puramente textuales. Pero sobre todo, las respuestas impresionan. Dependiendo de la complejidad de la pregunta, puede tardar hasta cinco minutos en recibir una respuesta de Qwen3. Por supuesto, puede observar durante el proceso de pensamiento e intervenir inmediatamente si la respuesta va completamente en la dirección equivocada.

Muchos otros modelos lingüísticos más pequeños también deberían funcionar bien en nuestro dispositivo de prueba. Sin embargo, cada modelo lingüístico también consume una cantidad significativa de espacio en la unidad SSD. Debería esperar de 3 a 7 GB por modelo lingüístico. Los pequeños SLM (Small Language Models) resultan ser sorprendentemente versátiles.

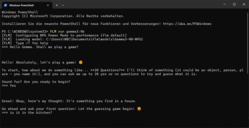

AI on the Go - FastFlowLM con soporte completo AMD-NPU

Lamentablemente, quienes utilicen LM Studio durante un viaje tendrán que estar preparados para que la batería se agote rápidamente. LM Studio recurre tanto a la CPU como a la GPU para todos los cálculos. La NPU de bajo consumo de nuestro Ryzen 7 350 quedó desgraciadamente intacta. FastFlowLM le permite aprovechar el rendimiento de la NPU del chip AMD. Esto viene con un consumo de energía significativamente menor, a pesar de que los LLM no se ejecutan notablemente más lento en la NPU. La calidad de las salidas permanece inalterada. Sin embargo, FastFlowLM es ligeramente más difícil de usar que LM Studio, ya que no viene con su propia interfaz gráfica de usuario. Puede obtener una interfaz gráfica para FastFlowLM a través de Open WebUI. De lo contrario, se utiliza a través de Windows PowerShell. Aunque podría ser una experiencia única.

Para comparar, medimos el consumo de energía del ordenador portátil al utilizar Gemma3:4b con LM Studio y FastFlowLM. Con FastFlowLM, el consumo máximo del portátil fue de aproximadamente 25 vatios. Significativamente mayor fue el consumo de energía cuando se utilizó el mismo modelo a través de LM Studio. Medimos un consumo de energía de unos 65 vatios. Ambos casos seguían teniendo una tasa de salida (en fichas por segundo) considerablemente superior a 10 fichas/segundo. Dependiendo de cómo lo calcule, Gemma3:4b alcanza entre 250 y 600 palabras por minuto con 10 tok/s. Como regla general, 1,8 tokens corresponden a una palabra alemana, 1,3 tokens a una palabra inglesa. Analizamos los textos en alemán creados por Gemma y llegamos a unas 450 palabras por minuto. Lo que es mucho más rápido que el lector típico.

Conclusión - La IA local es posible pero no siempre utilizable

Las funciones de IA de Windows funcionan a la perfección en el Acer Swift Go 16 AI. Sorprendentemente, las respuestas de SLM como Gemma3, Qwen3 y Granite 4 aparecen en la pantalla rápidamente pero con una calidad variable en función del modelo y la tarea. Cualquiera que definitivamente quiera utilizar los modelos Text2Image y otras funciones de Amuse probablemente debería optar por un portátil con más memoria. El Acer Swift Go 16 AI también está disponible con 32 GB de RAM.

En última instancia, la IA aún está en pañales. Todavía no existe software que sea fácil de usar y que utilice las capacidades de la NPU de AMD. Es lamentable, porque el rendimiento que pudimos conseguir con algunos retoques fue particularmente impresionante. Incluso Amuse muestra un potencial prometedor en el portátil, pero para nuestro gusto, genera demasiados mensajes de error y a veces es bastante lento.

Nuestras pruebas lo demuestran principalmente: Si quiere utilizar las funciones de IA de forma eficaz, necesita mucha RAM rápida. La mejor IA no sirve de nada si el resto de programas, como Word y los navegadores, se congelan mientras utiliza las funciones de IA.